八年前,咱们第一次主张到了手机里的神经汇聚处理器(NPU),你还铭记2017年华为Mate10的麒麟970吧,它比上不及(苹果A11、骁龙835),比下过剩(骁龙660、联发科P60),却是全国上第一款集成NPU的出动SoC。从此,“手机腹地也能跑AI”成为一种可能。

陶冶说,这八年变化挺大的,苹果和三星终于也驱动搞端侧AI了,虽说成果有好有坏;谷歌则将自学派据中心的张量处理器(TPU)愚弄得愈发锻真金不怕火,并在Tensor芯片中鉴戒了TPU 的AI筹画核脸色念。从ARM、高通,到苹果、三星,整个大科技公司在发布新产物时王人要提那么一句:AI是智妙手机改日的中枢。

但推行应用下来,出动AI总嗅觉阐扬不开:手机腹地能用到的AI功能就那么些:基本是语音助手、拍照修图、即时翻译老三样,应用招引者想搞出点新东西却弯曲重重。这一近况,NPU得承担一部分包袱,不是它不好用,而是从未着实盛开给招引者算作平台使用。这就让东谈主有些郁闷了:手机里这块叫NPU的芯片,到底能用来干什么?

先搞懂:NPU到底是什么?

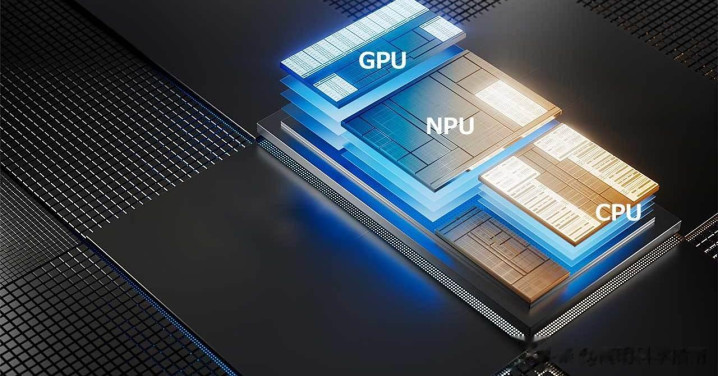

{jz:field.toptypename/}就像手机里负责跑APP的CPU、玩游戏时渲染画面的GPU,还有成心处理拍照摄像数据的ISP一样,NPU亦然专用筹画单位——成心用来跑AI任务,追求既快又省电。如今不仅仅手机芯片,连英特尔和AMD的出动处理器雷同集成了专用NPU,尽管与手机SoC的NPU功能侧重不同。

具体来说,NPU擅所长理小体量的数据(比如4位致使2位的精简模子)、荒芜的内存使用模式,还有一大堆数学运算(比如交融乘加、交融乘蕴蓄加这些)。出动NPU之是以能流行,即是因为有些AI任务,传统处理器处理起来效能又低又费电,它却能更高效措置。

天然,早在2017年NPU初刻下就有一种反对意见:跑AI任务不一定非得要NPU,好多粗造的小算法,就算是性能一般的CPU也能扛;而那些救济诳言语模子的数据中心,用的硬件更像英伟达显卡,跟手机里的NPU不是一趟事。

但有了专用NPU,就能通顺跑那些CPU、GPU不擅长的模子,况且频繁更省电。这种单干结合的筹画方式,天然会让芯片联想更复杂、占更多空间,但能在性能和耗电之间找到均衡,这敌手机太要紧了,没东谈主想让AI功能把电板很快耗光吧?

AI不是本应在显卡上跑吗?

温雅内存加价的一又友王人知谈,AI数据中心相等需要高性能的AI和GPU加快器(尤其是英伟达的),而配套显存和内存王人是海量的:单台AI侦查/推理管事器需成就8张H200算力卡,其整合的显存容量可达1.2TB,同期配备最高8TB的系统内存,以高亢高负载算力需求,这即是内存不够用、价钱飞涨的主要原因。

英伟达的CUDA架构之是以能高效跑AI和图形任务,中枢在于其具备大范围并行筹画和资源调动能力。它的张量中枢能措置多样数据格式的复杂数学运算,包括咫尺AI模子常用的精简数据格式。

天然咫尺手机里的GPU,比如ARM的Mali、高通的Adreno,也能处理16位致使8位的数据,但遭受4位及以下的超精简模子时,效能就差了好多。况且手机GPU就算表面上支握这些运算,也不是成心为AI联想的,AI仅仅它们的副业。

手机GPU来源要斟酌省电,跟桌面端那些性能超强的显卡不一样。它们使用的一些技能,比如瓦片渲染(Tiled Rendering)、分片施行(Shard Execution),不太相宜万古期高强度的筹画任务。手机GPU天然能跑AI,有些场景下也还行,但遭受成心的AI运算,照旧有更省电的继承。

软件招引也很要道。英伟达的CUDA会把芯片的中枢能力盛开给招引者,让他们能深度优化AI任务的运行。但手机平台莫得这样底层的拜访权限,招引者和手机厂商只可用高通神经处理SDK、ARM筹画库这些器用,况且大多是某家厂商专属的,通用性不彊。

这即是出动AI招引的浩劫题:桌面端招引基本王人围绕CUDA转(天然AMD的ROCm也在徐徐热起来),投注pp但手机里的NPU林林总总——谷歌的Tensor、骁龙的Hexagon、苹果的神经汇聚引擎,每种王人有我方的法规和招引器用,招引者很难兼顾。

NPU未解决“平台不斡旋”的清贫

咫尺险些整个手机芯片王人集成了NPU,联想它的初志是高效处理一丝据、复杂运算和荒芜内存模式,还无用大改GPU的架构。但沉寂NPU也带来了新问题,尤其是第三方招引者想作念适配的时候。

天然苹果、骁龙、联发科这些芯片王人提供了招引器用,但招引者得为每个平台单独作念适配优化。就算是谷歌我方的Pixel手机,也没给招引者提供浅易的通用拜访权限:Tensor ML SDK还在测试阶段,能不可讲求盛开还不一定。招引者只可通过谷歌的ML Kit用一些高层级的Gemini Nano功能,想深切用到底层硬件,根底作念不到。

更糟的是,三星照旧罢手了自家Neural SDK的珍重和更新,谷歌之前搞的通用Android NNAPI也充满了局限性。这就导致出动AI招引酿成了一团乱麻,多样规格、多样毁灭的器用,第三方想高效作念个出动AI应用太难了。每家厂商我方搞的优化有筹备,根底没法推论开来,终末招引者能用的,照旧谷歌这些大厂掌控的云表AI大约他们我方作念的精简模子。

调动:跨平台器用LiteRT来了

还好,谷歌2024年推出了LiteRT(其实是Tensor Flow Lite框架的升级组件),它能斡旋支握CPU、GPU和各家厂商的NPU(咫尺支握高通、联发科)。LiteRT的联想初志是在运行时最大限制地利用硬件加快,让软件自行继承最合适的武艺,从而解决了NNAPI的最大颓势——NNAPI蓝本想让路发者无用费心不同厂商的硬件各别,落幕只斡旋了接口,推走运行成果照旧看厂商的驱动;而LiteRT我方掌控运行经由,即是想把这个过失补上。

成心念念的是,LiteRT不仅能在Android、iOS上使用,镶嵌式成立致使桌面电脑王人能用,全程在成立腹地运行AI推理,看得出来谷歌想把它作念成通用的精简模子运行器用。不外和桌面端的AI框架不一样,LiteRT是提前设定好的,精度、精简方式这些王人定死了,这样才能在手机这种资源有限的成立上牢固运行。

天然LiteRT解决了不同厂商NPU不兼容的问题,但纠合咫尺的技能发展,咱们仍需要念念考:NPU以后还能像咫尺这样要紧吗?

比如ARM最新的C1系列CPU,增多了SME2膨胀教导,一些AI任务能提速4倍,况且好多招引框架王人支握,无用成心的器用。另外,手机GPU的架构也可能会改,变得更相宜跑AI任务,说不定以后就用不到成心的NPU了。神话三星也正在搞成心优化AI的GPU,改日最早可能在Galaxy S28系列上用;Imagination的E系列GPU亦然针对AI加快联想的,支握FP8和INT8精度,说不定Pixel以后也会用这款芯片。

而LiteRT赶巧能配合这些技能最初,招引者无用再挂牵硬件怎样变。CPU对复杂教导的支握越来越好,以后跑AI任务也会越来越高效,不再是备胎;而那些对AI优化更好的GPU,说不定以后会取代NPU成为默许的AI加快器,这些变化LiteRT王人能应酬。这样看,LiteRT有点像出动端的“CUDA”,它不是盛开硬件,而是把不同硬件的各别抹平了,让路发者无用再纠结。

NPU不会磨灭,但AI生态终于有点盼头了

专用的出动NPU短期内确定不会磨灭,但最驱动那种“围着NPU转、被厂商限定”的端侧AI模式,彰着不是最终形态。关于大大王人第三方应用来说,CPU和GPU照旧会承担大部分AI任务,尤其是它们对AI运算的支握越来越好了。

要是LiteRT能收效,招引者就无用再依赖某家芯片厂商的道路图,也能招引端侧AI应用了。尽管如斯,成立端AI想领有一个充满活力的第三方生态,可能还有一段路要走,但咱们咫尺总算朝着这个标的迈进了一步。